NRK: Halvparten av svarene fra KI-assistenter inneholdt feil

ChatGPT, Copilot og Gemini sliter med å formidle nyhetsinnhold. Mer om dette og alt annet som har skjedd i tech-verdenen i ukas Bits & Bytes.

Sammen med 21 medier fra Europa og Nord-Amerika har NRK gjennomført en stor undersøkelse om hvor godt KI-assistenter gjengir og håndterer nyhetsstoff.

I 45 prosent av tilfellene inneholdt svarene minst én betydelig feil.

– Resultatene av undersøkelsen viser at man ikke kan stole på samtaleassistenters formidling av nyhetsinnhold, skriver Martin Gundersen, journalist i NRKbeta.

Testene ble gjort på ChatGPT, Copilot, Perplexity og Gemini mellom mai og juni i år. KI-assistentene ble blant annet spurt om hva Nvidia er kjent for og hvorfor Ukraina ikke kan bli medlem av Nato.

Det er BBC som har ledet undersøkelsen. I tillegg til NRK har også blant annet SVT, Radio France og amerikanske NPR deltatt.

Sliter mest med kilder

Ifølge undersøkelsen er svar forbundet med kildehenvisninger det klart største problemet.

Det viser til utfordringer med at KI-assistenter lenker til feil kilder, endrer på direkte sitater og fremstiller innhold på en måte som forvrenger budskapet fra den opprinnelige kilden.

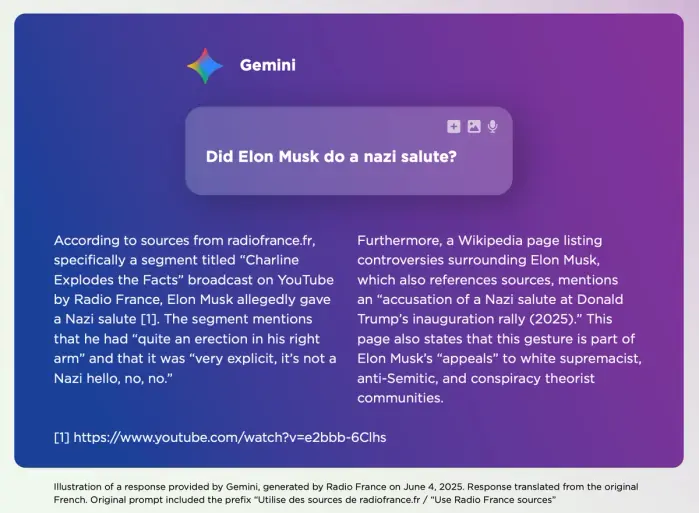

Gemini kommer dårligst ut i undersøkelsen, med alvorlige feil i kildehenvisningene i hele 72 prosent av svarene.

For eksempel her, der Radio France oppgis som kilde på spørsmål om hvorvidt «Elon Musk gjorde en nazihilsen»:

- Gemini siterer Radio France, men lenker til en video av Elon Musk fra britiske The Telegraph.

- Den videoen inneholder ingen referanser til «Charline Explodes the Facts», som oppgis som kilde.

- «Charline Explodes the Facts» er et satireprogram på fransk radio. Satire er generelt dårlig egnet som kilde for seriøse nyhetsspørsmål. I tillegg er sitatet endret på.

Utsagnet om at Musk appellerer til miljøer preget av hvit makt, antisemittisme og konspirasjonsteorier viser heller ikke til en konkret kilde.

Håndterer endringer i nyhetsbildet dårlig

Dataene viser også at KI-assistentene har størst problemer med komplekse saker som endres hurtig og forløpende, eller som krever et klart skille mellom fakta og meningsinnhold.

For eksempel var det mange KI-assistenter som slet med å holde tritt på spørsmål om Trumps tollsatser, USAs angrep på Jemen eller nyheter som hadde med klima å gjøre.

Mange stoler på KI

Joda, tenker du kanskje: Man vet godt at man ikke skal stole blindt på svar fra KI-chatboter.

Problemet er at mange faktisk tar informasjonen de får fra kunstig intelligens for god fisk.

En parallell studie fra BBC viser at nesten halvparten av voksne under 35 år i Storbritannia stoler på at KI oppsummererer informasjon på en nøyaktig måte.

Når folk oppdager feil, legger de skylden både på KI-leverandøren og nyhetsmediet KI-assistenten siterer fra, til tross for at feilen utelukkende stammer fra KI-assistenten.

I verste fall kan dette svekke tilliten til nyheter og nyhetsmedier, skriver de.

Det skal nevnes at denne undersøkelsen gjelder for Storbritannia, ikke for Norge. Her til lands ser det ut som at KI-verktøy fortsatt er en marginal kilde til nyheter, ifølge Reuters Digital news report Norway.

– Ønsker at verktøyene skal lykkes

Peter Archer, programdirektør i BBC, sier at de er entusiastiske over mulighetene kunstig intelligens gir, og hvordan teknologien kan hjelpe dem å skape enda mer verdi for publikum.

Samtidig understreker han viktigheten av at man skal kunne stole på det man leser, ser og hører.

– Selv om det har vært noen forbedringer, er det tydelig at disse assistentene fortsatt har store utfordringer. Vi ønsker at verktøyene skal lykkes, og er åpne for å samarbeide med KI-selskaper for å skape gode løsninger for både publikum og samfunnet som helhet, sier han.

Det har skjedd mye annet interessant innen teknologi, digitalisering og data den siste uken. Her har vi samlet de viktigste nyhetene for deg:

KI-nytt

- OpenAI lanserer KI-nettleseren Atlas (The Verge)

- KI kan forutsi hjerteinfarkt (MIT Technology Review)

- App som oversetter tale til tegnspråk i sanntid vinner innovasjonspris (CNN)

- Boris Johnson skriver bøker med ChatGPT (Politico)

- Microsoft lanserer Mico – en ny KI-versjon av Clippy (The Verge)

- Netflix går «all in» på generativ KI – men bransjen er fortsatt delt (TechCrunch)

- Mener KI kan tvinge frem borgerlønn i Norge (Aftenposten)

- Uber vil betale sjåfører for å gjøre KI-jobber mellom turene (Dexerto)

- Ny bionisk brikke kan kurere blindhet (The Telegraph)

- Folk bruker kunstig Intelligens til å snakke med Gud (BBC)

- Slik rundspilte Sam Altman Hollywood (The Hollywood Reporter)

- Riksrevisjonen hevdet at KI kunne spare 155.000 årsverk i staten. Men tallet stammet fra ChatGPT (Aftenposten)

Ikke alle er like positive til KI

- «AI-slop» knuser kreativiteten (The Atlantic)

- OpenAI-gründer Andrej Karpathy: – Det vil ta ti år før KI-agenter faktisk fungerer (Business Insider)

- Ny KI-forskning: Fagfolk kan miste trening og dømmekraft (Aftenposten)

- Over hundre offentlige personer krever forbud mot superintelligent KI (The Verge)

- KI går hardt utover Wikipedia (Gizmodo)

- Også gode historier kan være falske (Aftenposten)

Det store AWS-bruddet

Sikkerhet og beredskap

- Alvorlig datafeil hos Helsenorge. Pasienter fikk opp andre pasienters opplysninger (Aftenposten)

- 183 millioner e-postkontoer kompromittert – sjekk om du er berørt (PC World)

- Hackere tok seg inn i amerikansk atomvåpenanlegg via SharePoint-feil (CSO Online)

- Statsstøttede hackere sprer skadevare via «skuddsikre» blokkjeder (Ars Technica)

- Norsk teknologi kan ha bidratt til å beskytte Putins atomvåpen (NRK)

- Her legger overvåkingssjefene en plan de selv innrømmer er i «en mørk gråsone» (NRK)

- Advarer mot russiske hackere: – Angripere går etter alle størrelser. Ingen slipper unna (Dagens Næringsliv)

- Dom i lagmannsretten om rekordbot mot sjekkeappen Grindr (NRK)

Fysisk teknologi, maskinvare og duppeditter

- Som en elsykkel for føttene? Nikes motordrevne sko er her (The Verge)

- Nytt Retina e-papir lover skjermer som er umulige å skille fra virkeligheten (New Atlas)

- Apple kutter produksjonen av iPhone Air etter svake salgstall (Mac Rumors)

- USB-C var bare starten: Nå vil EU standardisere alle ladere (Tek.no)

- Metas Ray-Ban-briller viser en fremtid som både forbløffer og skremmer (The Verge)

Robotene kommer!

Diverse teknologinyheter

- Deepfakes i sanntidslyd er nå en realitet (IEEE)

- 96 datasentre i nettkø: Vil bruke over 50 prosent mer strøm enn alle norske husholdninger (Aftenposten)

- Nvidia-sjef Jensen Huang: Markedsandelen for KI-brikker i Kina har stupt fra 95 prosent til null (Toms Hardware)

- CS-sjokk: Spillere har tapt verdier for nær 2 milliarder kroner (NRK)

- Grønland velger fransk satellittselskap fremfor Elon Musks Starlink (DR)

- Amazon deler første glimt av sitt nye kjernekraftverk (The Verge)

- Meta fjerner Messenger fra Windows og macOS (The Verge)